Foto de Cristian Cristian no Unsplash

Em um futuro próximo, será possível ativar o alto-falante Amazon Echo ou Nest Audio, pesquisar no Google ou Siri em aparelhos Apple sem uma saudação como "Olá, Google!" Usando IA, cientistas dos Estados Unidos desenvolveram um algoritmo graças ao qual assistentes de voz inteligentes entendem que uma pessoa está falando com eles.

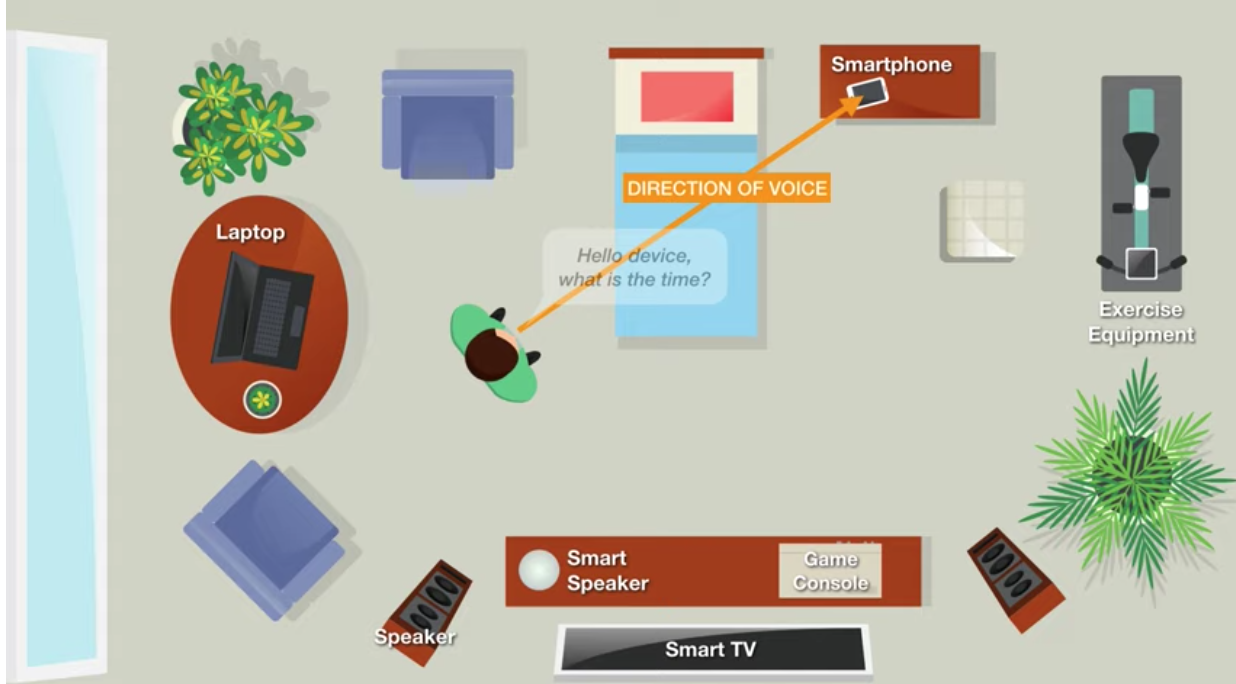

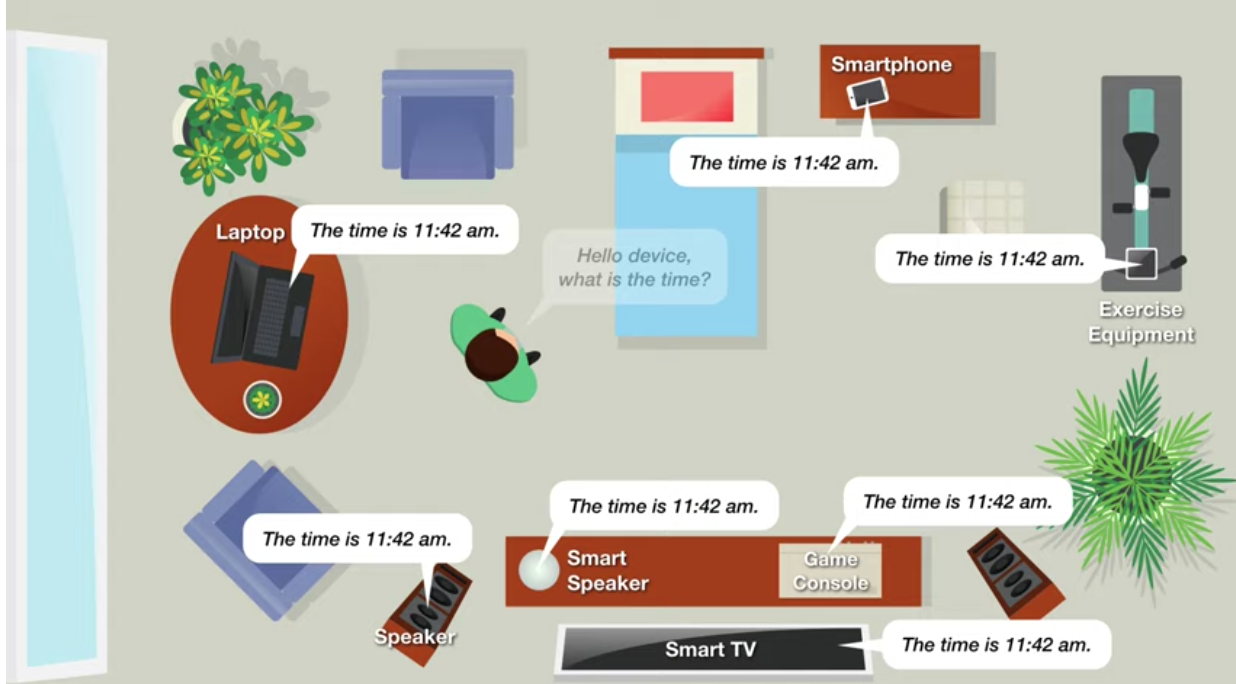

Na conversa normal, as pessoas designam o destinatário da mensagem simplesmente olhando para ela. Mas a maioria dos dispositivos de voz são adaptados para ativação com frases-chave que ninguém pronuncia na comunicação real. A compreensão de pistas não verbais por assistentes de voz tornaria a comunicação mais fácil e intuitiva. Especialmente se houver vários desses dispositivos em casa.

Cientistas da Carnegie Mellon University observam que o algoritmo desenvolvido determina a direção da voz (DoV) usando um microfone.

O DoV é diferente de detectar a direção de chegada (DoA).

Segundo os pesquisadores, o uso do DoV possibilita comandos direcionados, que lembram o contato visual com os interlocutores ao iniciar uma conversa. Porém, as câmeras dos aparelhos não estão envolvidas. Assim, há uma interação natural com diferentes tipos de dispositivos sem confusão.

Entre outras coisas, a tecnologia reduzirá o número de ativações acidentais de assistentes de voz que ficam em standby o tempo todo.

A nova tecnologia de áudio é baseada nos recursos de propagação do som da fala. Se a voz for direcionada para o microfone, ela será dominada por frequências baixas e altas. Se a voz for refletida, ou seja, inicialmente direcionada para outro dispositivo, haverá uma diminuição perceptível nas frequências altas em comparação com as baixas.

O algoritmo também analisapropagação do som nos primeiros 10 milissegundos. Dois cenários são possíveis aqui: O

usuário está voltado para o microfone. O sinal que chega primeiro ao microfone será claro em comparação com outros sinais possíveis refletidos de outros dispositivos na casa.

O usuário é afastado do microfone. Todas as vibrações de som serão duplicadas e distorcidas.

O algoritmo mede a forma do sinal, calcula o pico de sua intensidade, compara com o valor médio e determina se a voz foi direcionada para o microfone ou não.

Ao medir a propagação da voz, os cientistas foram capazes de determinar, com uma precisão de 93,1%, se um alto-falante está na frente de um determinado microfone ou não. Eles observaram que este é o melhor resultado até o momento e um passo importante para implementar a solução em dispositivos existentes. Ao tentar determinar um dos oito ângulos em que uma pessoa olha para o dispositivo, obteve-se uma precisão de 65,4%. Isso ainda não é suficiente para um aplicativo cuja essência é a interação ativa com os usuários.

Para coletar informações, os engenheiros usaram Python, os sinais foram processados com base no algoritmo classificador Extra-Trees.

Os dados e algoritmos coletados durante o desenvolvimento são abertos ao GitHub . Eles podem ser usados ao criar seu próprio assistente de voz.