Autor: Eugenio Culurciello, título original: The fall of RNN / LSTM

Tradução: Davydov A.N.

Adoramos RNNs (Redes Neurais Recorrentes), LSTMs (Memória de longo-curto prazo) e todas as suas variantes. E agora é hora de desistir deles!

Em 2014, LSTM e RNN foram ressuscitados. Mas éramos jovens e inexperientes. Por vários anos, eles têm sido uma forma de resolver problemas como aprendizado sequencial, tradução de sequência (seq2seq). Eles também possibilitaram alcançar resultados surpreendentes na compreensão da fala e na sua tradução em texto. Essas redes alimentaram o surgimento de assistentes de voz como Siri, Cortana, Google e Alexa. Não podemos esquecer a tradução automática, que nos permitiu traduzir documentos em diferentes idiomas. Ou tradução automática de rede neural, que permite traduzir imagens em texto, texto em imagens, criar legendas para vídeos, etc.

Então, nos anos seguintes (2015-16), surgiu a ResNet e o Attention. Então começou a entender-se que o LSTM era uma técnica inteligente para contornar, não resolver um problema. A atenção também mostrou que as redes MLP (Multi-Layer Perceptron Neural Networks) podem ser substituídas por redes de média dirigidas por um vetor de contexto. (mais sobre isso mais tarde).

Passaram-se apenas 2 anos e hoje podemos dizer com certeza:

"Knock up com RNN e LSTM, eles não são tão bons!"

, , Attention , , . RNN Attention . RNN , , Attention.

?

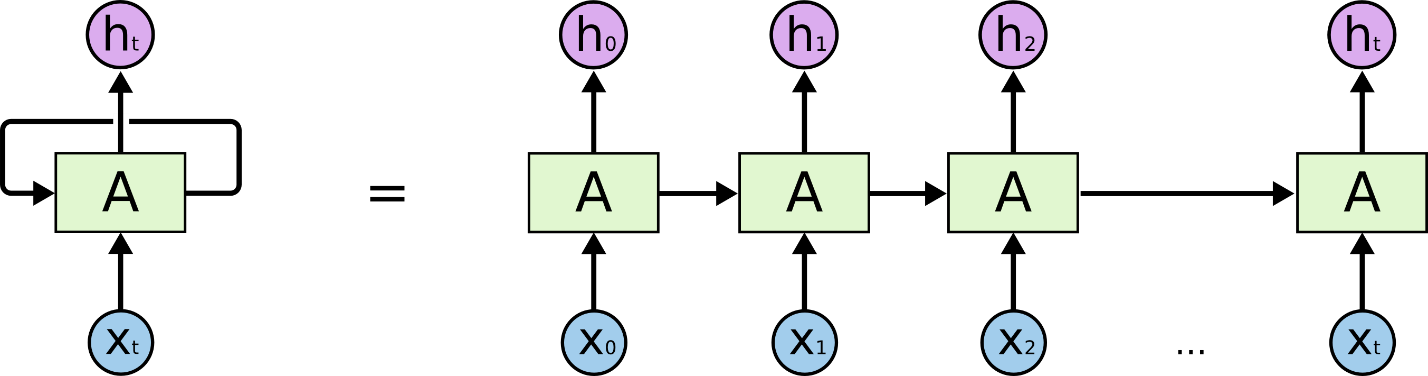

, RNN, LSTM . :

, , . , , 0, .

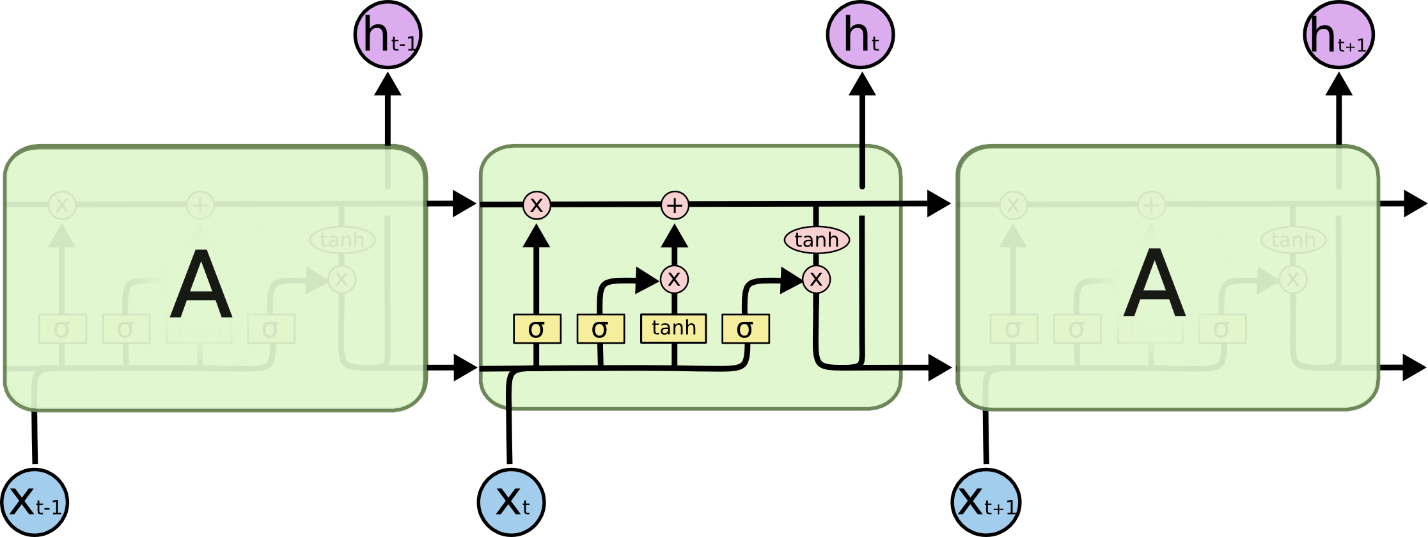

LSTM. , , ResNet. () . LSTM . .

. , , . , LSTM, GRU ! (100), .

RNN , . , ( ), . RNN . , , , Amazon Echo!

?

2D , RNN/LSTM, Attention, Transformer

Transformer 2017 , . , .

: , , « » , « », - ( ) , , . , / .

« », , :

- , Ct

, , . (TCN), 3 .

«» , 100 , 100 «» 100 . 100100 . 10 000 .

, .

, , , : , N (log(N)), N – . , RNN, – . T N (T>>N)

, 3-4 100!

, , «». , , .

? , . , , : , – , . , , . , . , , , .

– RNN . Attention. , - , !

RNN\LSTM: RNN LSTM , , . , LSTM 4 ( MLP) . , , . , ( , . .). RNN / LSTM , . , , FWDNXT.

1: WaveNet. . : .

2: RNN LSTM - ( . ). () , / , ! , - . - , ( ).

3: , CNN RNN. (TCN) « , LSTM, , ».

4: , , . « , , 858 534 22 30, . , »- , «» (Attention), , , (TCN). , RNN, , . , (, 5 ), , , , .

5: , , , . «» . , ! !

6: Attention Transformer, . VGG NLP? , LSTM , . LSTM Transformer ( ), , , « LSTM Transformer - MRPC »