autoajuda de 1.000 palavras explica que pensar demais é inimigo da criatividade e aconselha: “Para fazer algo, talvez tenhamos de pensar menos. Parece contra-intuitivo, mas acho que às vezes nossos pensamentos podem atrapalhar o processo criativo. Às vezes, podemos trabalhar melhor quando nos 'desconectamos' do mundo exterior, focando no que está à nossa frente. "

A postagem foi escrita por GPT-3, uma enorme rede neural Open AI com 175 bilhões de parâmetros treinados em quase meio trilhão de palavras. O aluno da UC Berkeley, Liam Porr, apenas escreveu o título e deixou o algoritmo escrever o texto. Um " experimento divertido " para ver se a IA pode enganar as pessoas. Na verdade, o GPT-3 deixou os nervos à flor da pele com esta postagem alcançando o número um no Hacker News.

Portanto, há um paradoxo com a IA de hoje. Embora alguns dos papéis do GPT-3 possam satisfazer o teste de Turing em convencer as pessoas de que são humanas, eles claramente falham nas tarefas mais simples. O pesquisador de inteligência artificial Gary Marcus perguntouGPT-2, o predecessor do GPT-3, termine esta frase:

“O que acontece quando você coloca lenha e lenha na lareira e depois joga alguns fósforos? Normalmente vai começar ... ”

“ Fogo ”é o que qualquer criança grita imediatamente. Mas a resposta do GPT-2: "Ick" O

experimento falhou. O caso está encerrado?

Matéria escura de linguagem natural

A comunicação humana é um processo de otimização. O falante minimiza o número de declarações necessárias para transmitir seus pensamentos ao ouvinte. Tudo o que é esquecido é chamado de bom senso. E como o ouvinte tem o mesmo bom senso do falante, ele pode dar sentido ao enunciado.

Portanto, por definição, o bom senso nunca é escrito. Como o estudioso da NLU Walid Saba apontou , não estamos dizendo:

Charles, que é um jovem adulto vivo e estava fazendo pós-graduação, largou a pós-graduação para ingressar em uma empresa de software em busca de um novo funcionário.

Colocamos de forma mais simples:

Charles largou a pós-graduação para trabalhar para uma empresa de software

e assumimos que nosso interlocutor já sabe:

- Você deve estar vivo para frequentar a escola ou ingressar na empresa.

- Você deve estar na pós-graduação para sair.

- A empresa deve ter uma posição aberta para fechá-la.

Etc. Todos os enunciados humanos são assim, eles estão cheios de regras invisíveis de bom senso que nunca declaramos explicitamente. Assim, o bom senso pode ser comparado à matéria escura na física: ela é invisível, mas constitui o grosso.

Então, como as máquinas podem aprender o bom senso artificial? Como eles podem saber que estamos jogando porque queremos acender um fogo?

Senso comum artificial: o método da força bruta

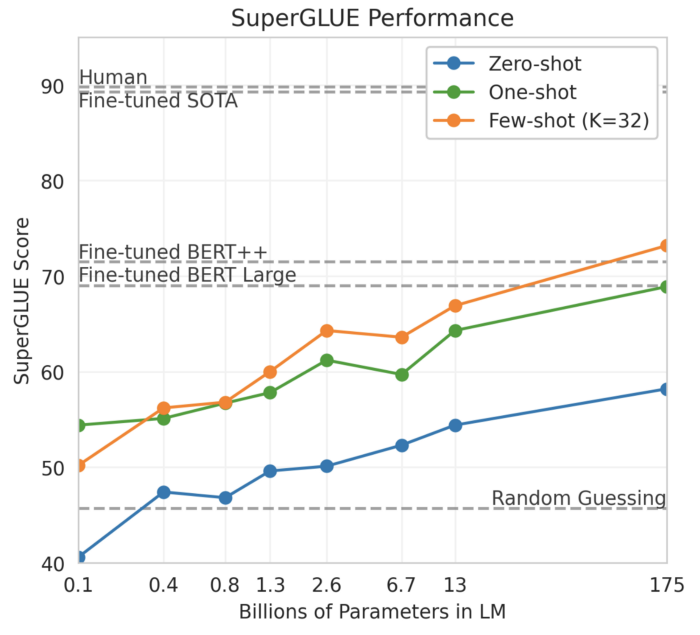

Há razões para acreditar que podemos usar a força bruta no bom senso artificial, e essa razão é a inclinação da curva no gráfico a seguir:

Desempenho do GPT-3 no SuperGLUE

Este gráfico do trabalho do GPT-3 " Modelos de linguagem FSL " mostra o desempenho do modelo SuperGLUE como uma função do número de parâmetros do modelo, com o modelo GPT-3 completo à direita. SuperGLUE contém algumas tarefas semânticas bastante complexas, como os esquemas do Winograd:

O troféu não cabe em uma mala marrom porque é muito pequeno.

O que é pouco?

Resposta: uma mala.

Vale ressaltar que em 175 bilhões de parâmetros, a curva ainda está crescendo: o ponto máximo ainda não foi atingido. Portanto, uma hipótese é que deveríamos ser capazes de construir modelos ainda maiores com trilhões ou mais parâmetros e, eventualmente, o bom senso artificial surgirá. Vamos chamar essa suposição de hipótese da "força bruta".

No entanto, esta é apenas uma hipótese, e não sabemos se é realmente verdadeira ou não. O contra-argumento aqui é que uma máquina simplesmente não pode aprender com algo que não está explicitamente declarado.

Regras infinitas

Se queremos ensinar bom senso às máquinas, por que não apenas escrever tudo como regras e depois passar essas regras para a máquina? Isso é exatamente o que Douglas Lenat se propôs a fazer na década de 1980. Ele contratou cientistas da computação e filósofos para criar a base de conhecimento de senso comum conhecida hoje como Cyc. Hoje, Cyc contém 15 milhões de regras, tais como:

1. Um morcego tem asas.

2. Como tem asas, o morcego pode voar.

3. Como o morcego pode voar, ele pode viajar de um lugar para outro.

O problema com um sistema codificado como Cyc é que as regras são infinitas: para cada regra há uma exceção, uma exceção de uma exceção e assim por diante. Como o morcego tem asas, ele pode voar, a menos que quebre sua asa. Esse loop infinito torna o conjunto de regras cada vez mais complexo, tornando mais difícil para os humanos manter a memória de uma máquina, e para as máquinas mantê-la.

Portanto, não é surpresa que, apesar de décadas de esforço, o Cyc ainda não funcione e talvez nunca funcione. O professor Pedro Domingos, da Universidade de Washington, chama o Cyc de "o maior fracasso da história da inteligência artificial". Oren Etzioni, CEO do Allen Institute for Artificial Intelligence, outro crítico, comentou em uma entrevista à Wired: "Se funcionasse, as pessoas saberiam que funciona."

Vamos resumir. Para a IA "real", precisamos criar um bom senso artificial. Mas existem argumentos convincentes contra a hipótese da força bruta. Por outro lado, existem argumentos convincentes contra as regras codificadas. E se combinássemos o melhor nessas abordagens?

Abordagem híbrida

Conheça o COMET , um modelo baseado em transformador desenvolvido pelo professor Yejin Choi da Universidade de Washington e seus colaboradores. A essência do modelo é que ele aprende na base de conhecimento "semente" do bom senso e, em seguida, expande essa base, gerando novas regras a partir de cada nova afirmação. Assim, o COMET é uma forma de "carregar" o bom senso artificial. Em seu artigo, os pesquisadores escrevem que o COMET "freqüentemente fornece um novo conhecimento de senso comum que os avaliadores acreditam ser corretos".

Como teste, digitei o texto: "Gary coloca lenha e toras na lareira e, em seguida, joga alguns fósforos" na API COMET , e aqui está parte do gráfico de saída:

Alguns dos gráficos inferidos do COMET de bom senso

concluem corretamente que Gary * queria * acender uma fogueira. O sistema também indica que "fica quente como resultado de Gary". Em minha opinião, isso soa muito melhor do que a resposta do GPT-3 à mesma solicitação.

Então, o COMET é uma solução para o problema do senso comum artificial? Isso ainda está para ser visto. Se, digamos, o COMET atingir um desempenho de nível humano no SuperGLUE, será sem dúvida um avanço no campo.

Por outro lado, os críticos podem argumentar que o bom senso não pode ser medido com conjuntos de dados de referência artificiais. Há o risco de que, depois de criar esse conjunto de dados de referência, os pesquisadores em algum momento comecem a retreinar o modelo, tornando o resultado de referência sem sentido. Uma linha de pensamento é testar a IA com os mesmos testes de inteligência que os humanos. Por exemplo, os pesquisadores Stellan Olsson e funcionários da Universidade de Illinois em Chicago sugerem testar o bom senso artificial usando testes de QI em crianças pequenas.

Não se deixe enganar pela IA de hoje

Finalmente, não se deixe enganar pela IA de hoje. Olhando novamente para o artigo GPT-3, percebo que muitas de suas declarações são superficiais e generalizadas, como no biscoito da sorte:

É importante manter a mente aberta e experimentar coisas novas.

E essa superficialidade é provavelmente a razão pela qual tantas pessoas podem ser enganadas. Em última análise, a superficialidade esconde uma falta de compreensão verdadeira.

- Treinamento para a profissão de ciência de dados

- Treinamento de analista de dados

- Curso de Aprendizado de Máquina

Outras profissões e cursos