IA aprende a gerar imagens a partir de assinaturas e começa a entender melhor nosso mundo

De todos os modelos de inteligência artificial, foi o GPT-3 da OpenAI que mais capturou a imaginação do público. Ela, sem muito estímulo, consegue vomitar poemas, contos e canções, fazendo pensar que se trata de obra de uma pessoa. Mas eloqüência é apenas um truque e não deve ser confundida com inteligência real.

No entanto, os pesquisadores acreditam que as mesmas técnicas usadas para criar GPT-3 escondem um segredo para a criação de IA mais avançada . GPT-3 foi treinado em uma grande quantidade de informações de texto. E se as mesmas técnicas fossem treinadas simultaneamente em texto e imagens?

Um novo estudo denominado AI2 do Instituto Paul Allen de Inteligência Artificial levou essa ideia a um novo nível. Os pesquisadores criaram um modelo visual-linguístico especial. Trabalha com texto e imagens e pode gerar estas a partir de assinaturas. As imagens parecem perturbadoras e estranhas, nada parecidas com os deepfakes hiper-realistas criados por redes adversárias geradoras (GANs). Mas eles podem mostrar uma nova direção para uma inteligência mais prática e talvez tornar os robôs mais inteligentes.

Preencha no espaço em branco

O GPT-3 pertence a um grupo de modelos conhecidos como "transformadores". Eles ganharam popularidade graças ao sucesso do BERT, o algoritmo do Google. Antes do BERT, os modelos de linguagem eram muito ruins. Suas habilidades preditivas foram suficientes para o preenchimento automático, mas não para a composição de frases longas, onde regras gramaticais e bom senso são observados.

O BERT mudou a situação introduzindo uma nova técnica chamada mascaramento ( nota - o nome original é mascaramento). Isso implica que palavras diferentes estão escondidas na frase e o modelo deve preencher a lacuna. Exemplos:

- A mulher foi a ___ para praticar.

- Eles compraram ___ pão para fazer sanduíches.

A ideia é que se você forçar o modelo a fazer esses exercícios, muitas vezes um milhão de vezes, ele começará a descobrir padrões em como as palavras são reunidas em sentenças e as sentenças em parágrafos. Como resultado, o algoritmo gera e interpreta melhor o texto, chegando mais perto de compreender o significado da linguagem. (O Google agora está usando o BERT para fornecer resultados de pesquisa mais relevantes.) Depois que o mascaramento provou ser extremamente eficaz, os pesquisadores tentaram aplicá-lo a modelos de linguagem visual, ocultando palavras em assinaturas. Nesse caminho:

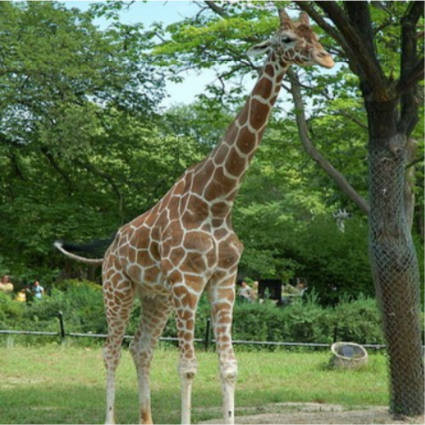

____ está no chão próximo a uma árvore. Fonte: AI2

Desta vez, o modelo pode olhar as palavras ao redor e o conteúdo da imagem para preencher a lacuna. Depois de um milhão de repetições, ela aprendeu a detectar não apenas os padrões das palavras, mas também a conexão das palavras com os elementos de cada imagem.

Como resultado, os modelos podem vincular relações textuais a exemplos visuais de como os bebês fazem conexões entre palavras aprendidas e coisas que vêem. Os modelos podem tirar a foto abaixo e colocar uma legenda significativa, como "Mulheres jogando hóquei em campo". Ou podem responder a uma pergunta como "De que cor é a bola" associando a palavra "bola" a um objeto circular em uma fotografia.

Um modelo de linguagem visual pode criar uma legenda significativa para esta fotografia: "Mulheres jogando hóquei em campo". Fonte: JOHN TORCASIO / UNSPLASH

Melhor ver a foto uma vez

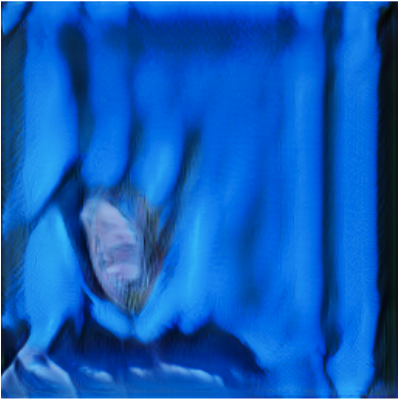

Os pesquisadores queriam saber se esses modelos desenvolvem uma compreensão conceitual do mundo visual. Uma criança que aprendeu uma palavra para um objeto pode não apenas nomeá-lo, mas também desenhar o objeto de acordo com a dica, mesmo se o próprio objeto estiver ausente. Portanto, a equipe do projeto AI2 sugeriu que os modelos fizessem o mesmo: gerassem imagens a partir das legendas. Todos os modelos distribuíram lixo de pixel sem sentido.

Isso é um passaro? Este é um avião? Não, isso é jargão, gerado por inteligência artificial. Fonte: AI2

Faz sentido: converter texto em imagem é mais difícil do que fazer o contrário. "A assinatura não define tudo na imagem", diz Ani Kembhavi, líder da equipe de visão computacional da AI2. Portanto, o modelo deve se basear em uma grande quantidade de conhecimento sobre nosso mundo para adicionar detalhes que faltam.

Por exemplo, se uma modelo for solicitada a desenhar uma "girafa caminhando ao longo de uma estrada", ela precisará concluir que a estrada será cinza em vez de rosa brilhante e passará próximo a um campo em vez do mar. Embora todas essas informações não sejam explícitas.

Portanto, Kembhavi e seus colegas Jemin Cho, Jiasen Lu e Hannane Hajishirzi decidiram ver se poderiam ensinar ao modelo todo esse conhecimento visual oculto ajustando a abordagem de mascaramento. Em vez de treinar o algoritmo para simplesmente prever as palavras "mascaradas" nas legendas das fotos correspondentes, eles também o treinaram para prever os pixels "mascarados" nas fotos com base nas legendas correspondentes.

As imagens finais criadas pelo modelo não são totalmente realistas. Mas não é importante. Eles contêm os conceitos visuais de alto nível corretos. AI se comporta como uma criança desenhando um manípulo para representar uma pessoa. (Você pode testar o modelo aqui ).

Imagens de amostra geradas pelo modelo AI2 a partir das legendas. Fonte: AI2

A capacidade dos modelos de linguagem visual de gerar tais imagens representa um importante passo à frente na pesquisa de inteligência artificial. Isso sugere que o modelo é realmente capaz de um certo nível de abstração - uma habilidade fundamental para entender o mundo.

A longo prazo, a habilidade pode ter implicações importantes para a robótica. Quanto melhor o robô entende o ambiente e usa a linguagem para se comunicar, mais tarefas complexas ele será capaz de realizar. No curto prazo, observa Hajishirzi, a visualização ajudará os pesquisadores a entender melhor o que o modelo está aprendendo, que agora funciona como uma caixa preta.

No futuro, a equipe planeja experimentar mais, melhorar a qualidade de geração de imagens e expandir o visual e o vocabulário do modelo: para incluir mais tópicos, objetos e adjetivos.

“A criação das imagens era realmente a peça que faltava no quebra-cabeça”, diz Lu. "Ao adicioná-lo, podemos ensinar o modelo a compreender melhor o nosso mundo."