O mundo tecnológico abraçou um novo hype - GPT-3.

Enormes modelos de linguagem (como GPT-3) nos surpreendem cada vez mais com seus recursos. Embora a confiança dos negócios neles ainda não seja suficiente para apresentá-los a seus clientes, esses modelos demonstram o início da inteligência que irá acelerar o desenvolvimento da automação e os recursos dos sistemas de computação "inteligentes". Vamos tirar a aura de mistério da GPT-3 e descobrir como ela aprende e como funciona.

O modelo de idioma treinado gera texto. Também podemos enviar algum texto para a entrada do modelo e ver como a saída muda. O último é gerado a partir do que o modelo "aprendeu" durante o período de treinamento, analisando grandes quantidades de texto.

Aprendizagem é o processo de transferência de uma grande quantidade de texto para um modelo. Para GPT-3, este processo está completo e todos os experimentos que você pode ver estão sendo executados no modelo já treinado. Foi estimado que o treinamento deveria ter levado 355 anos de GPU (355 anos de treinamento em uma única placa de vídeo) e custar US $ 4,6 milhões.

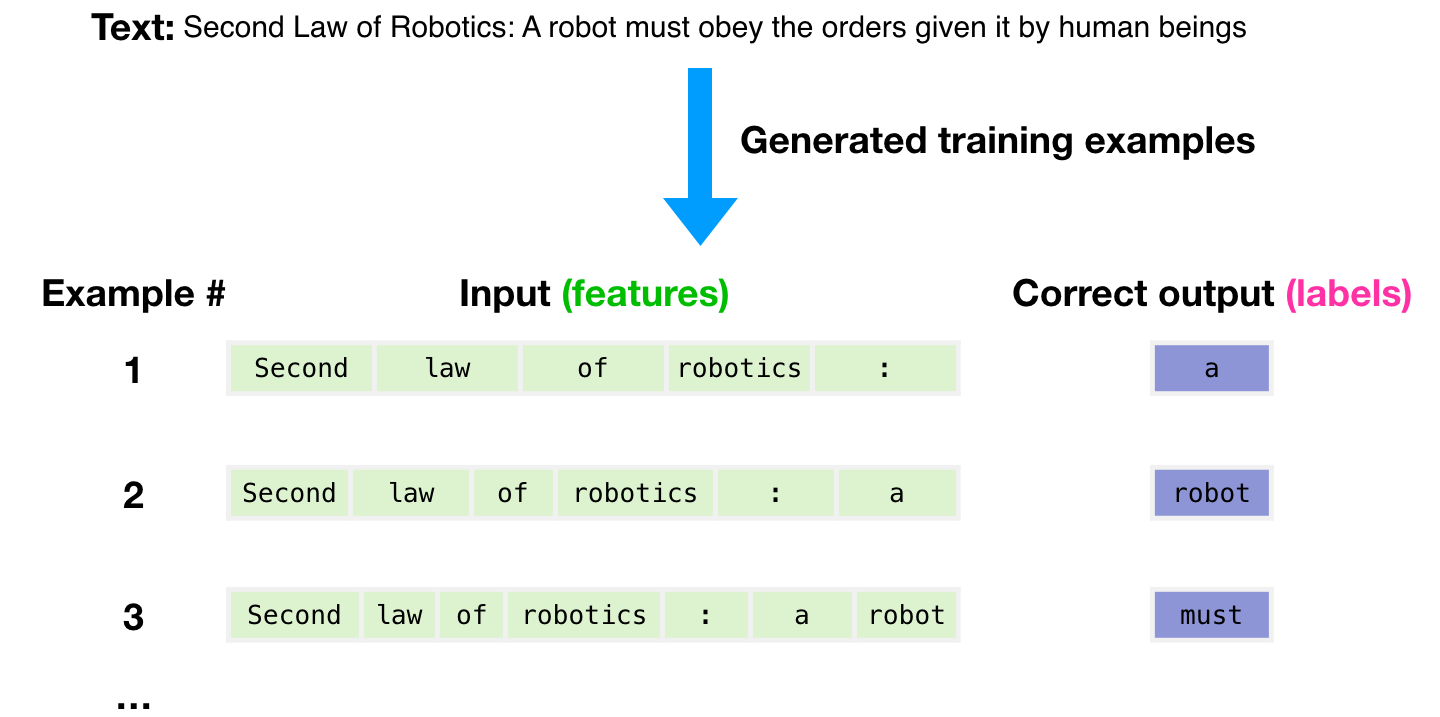

Um conjunto de dados de 300 bilhões de tokens de texto foi usado para gerar exemplos para treinar o modelo. Por exemplo, é assim que três exemplos de treinamento se parecem, derivados de uma frase acima.

, , .

( ) .

. , .

.

.

GPT-3 ( , – ).

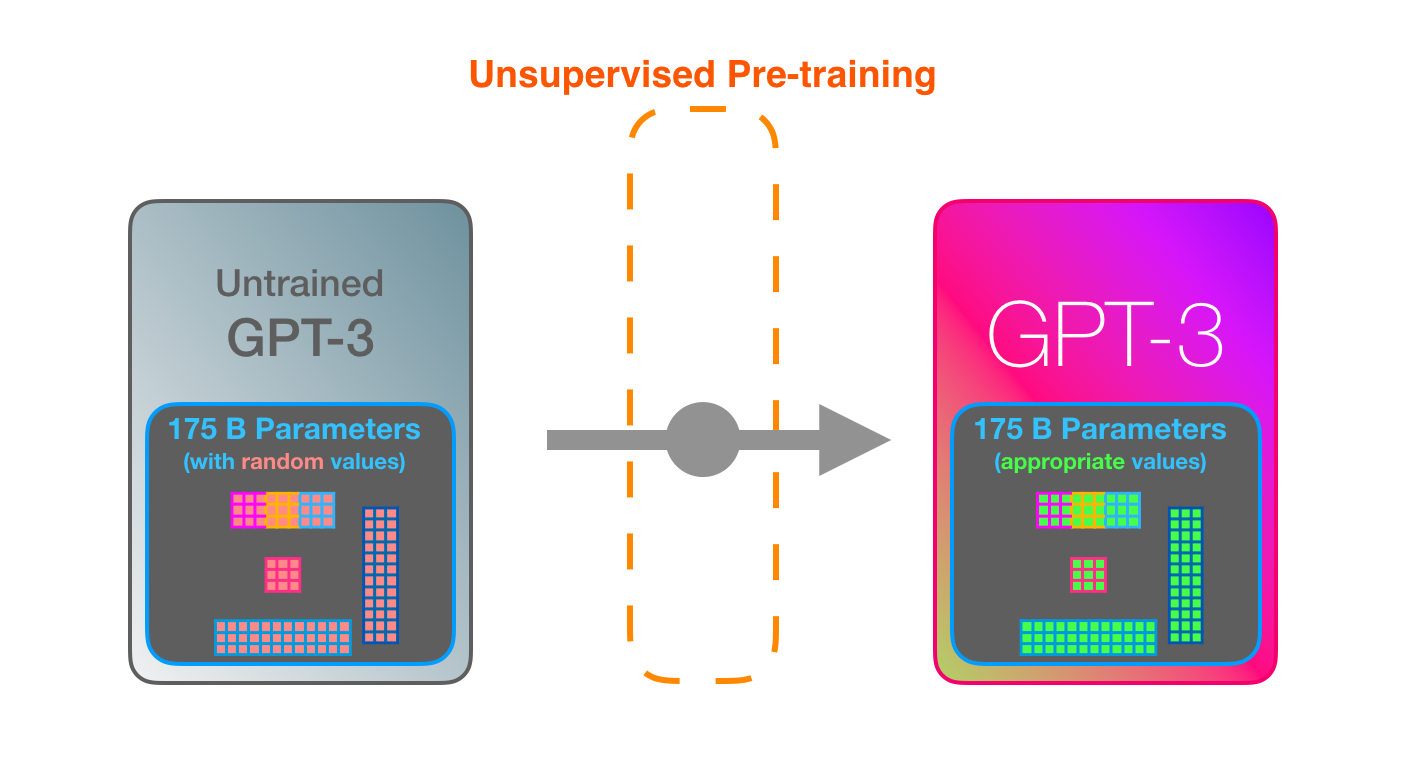

GPT-3 . , , 175 ( ). .

, , .

– , – , .

« Youtube» – 175- .

, , .

GPT-3 2048 – « », 2048 , .

. «robotics» «A»?

:

- ( ).

- .

- .

GPT-3 96 .

? «» « » (deep learning).

1.8 . «». :

, , GTP-2 .

GPT-3 (dense) (sparse) (self-attention).

«Okay human» GPT-3. , . : , . .

React ( ), , => . React , , .

Pode-se supor que os exemplos e descrições iniciais foram adicionados à entrada do modelo, junto com tokens especiais que separam os exemplos do resultado.

A forma como funciona é impressionante. Você apenas tem que esperar que o ajuste fino do GPT-3 seja concluído. E as possibilidades serão ainda mais incríveis.

O ajuste simplesmente atualiza os pesos do modelo para melhorar seu desempenho para uma tarefa específica.

Autores

- Autor original - Jay Alammar

- Tradução - Ekaterina Smirnova

- Edição e layout - Sergey Shkarin