O tópico da atualização da lei de Moore encontrando dependências mais complexas da evolução dos sistemas de computação trazido para discussão é hoje bem compreendido por pesquisadores no campo das tecnologias plasmônica e nanofotônica.

Importante: a maioria dos links do artigo leva a materiais em inglês. Não há tantos pesquisadores nacionais de fotônica na Rússia, e os que existem preferem ser publicados em inglês.

Para um estudo adicional do tópico em seu lazer, enquanto toma uma xícara de chá, você está convidado a ouvir o relatório de Dmitry Fedyanin - um dos principais pesquisadores russos na aplicação de tecnologias nanofotônicas em sistemas de computação.

Dmitry Fedyanin é pesquisador sênior do MIPT.

Em seguida, analisaremos um interessante artigo em que um grupo de autores propõe um conceito extremamente original da métrica de crescimento da produtividade, uma alternativa à clássica lei de Moore. A ideia amadureceu graças à análise das limitações físicas naturais nas tecnologias existentes para o funcionamento de núcleos de processadores, bem como às perspectivas confirmadas experimentalmente de novos sistemas baseados em nanofotônica.

As demandas contínuas feitas pelo sistema industrial moderno para melhorar a eficiência computacional e a largura de banda de comunicação trouxeram as tecnologias de semicondutores aos seus limites em seu estado atual. Isso levou ao surgimento de novas tecnologias que podem superar as soluções tradicionais. Estamos falando de pré-processadores ou aceleradores fotônicos, circuitos híbridos elétron-fóton e redes neurais. No entanto, os esforços feitos para descrever e prever a evolução do desempenho dos sistemas de computação não permitem prever com precisão e, portanto, explicar a taxa de desenvolvimento realmente observada; ou seja, todos os indicadores propostos eventualmente se desviam de sua trajetória de desenvolvimento vários anos após terem sido propostos originalmente. Essa discrepância requer uma métrica equilibrada,que incluiria um conjunto holístico de forças motrizes por trás da evolução dos sistemas de computação.

O conceito original de uma nova métrica chamada Capacidade para Latência-Quantidade-Resistência (CLEAR) foi proposto por uma equipe internacional de pesquisadores (Shuai Sun, Vikram K. Narayana, Mario Miscuglio, Lionel C. Kimerling, Tarek El-Ghazawi, Volker J. Sorger). De acordo com os autores do artigo (veja aqui) esta métrica cobre a dinâmica das mudanças nas taxas de sincronização, eficiência energética, dimensionamento do tamanho físico dos computadores e custos econômicos. Segundo os autores, CLEAR é a única métrica hoje que descreve corretamente o desenvolvimento histórico dos sistemas de computação. Mesmo com diferentes opções e combinações tecnológicas mútuas, CLEAR é consistente com a taxa de crescimento constante observada, incluindo as tecnologias de computação dominantes propostas para implementação no futuro (previsão). CLEAR é apresentado aos leitores como um guia para prever quantitativamente o aumento da produtividade dos sistemas de computação no momento e no futuro.

Apesar do fato de que, em geral, a evolução do desempenho da computação está constantemente aumentando, a velocidade observada de desempenho dos dispositivos baseados na indústria de semicondutores existente diminui visivelmente, especialmente na tecnologia de 14 nm (veja aqui e aqui ). Isso se deve tanto às restrições físicas naturais quanto aos crescentes custos econômicos do processo contínuo de produção de chips industriais.

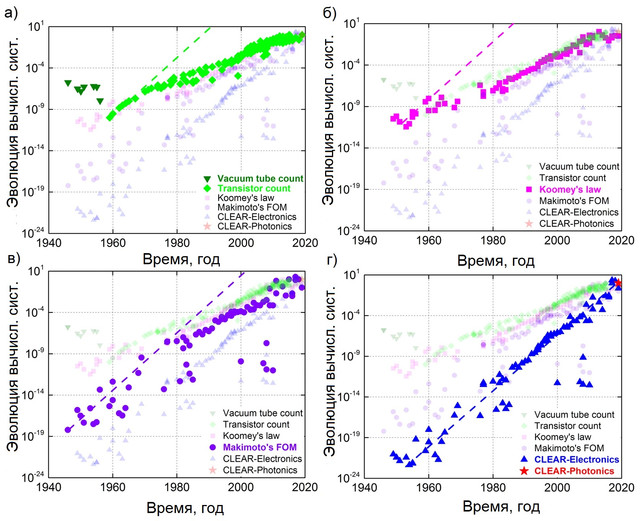

Por essas razões, a Lei de Moore como um roteiro para a indústria de semicondutores foi revisada várias vezes para remover esses obstáculos (veja aqui) Da mesma forma, a dinâmica de desenvolvimento (dependência do tempo) de outras relações de grandezas físicas, como o indicador da eficiência do uso do poder de computação ( lei de Kumi ) ou o indicador de poder de computação derivado da relação entre consumo de energia, tamanho e custo ( lei de Makimoto ), como resultado, todos da mesma forma se desvia em comparação com a taxa observada de desenvolvimento de tecnologia (Fig. 1) - a função de tempo escolhida no indicador (por exemplo, multicore, custo de fabricação) na prática não pode fornecer crescimento exponencial.

Por exemplo, o desempenho de um processador com N núcleos ainda é limitado pela razão 1 / ((1-p) + p / N) , onde p é o nível de paralelização (consulte.aqui ). Portanto, torna-se cada vez mais difícil acompanhar a evolução do desempenho dos sistemas de computação se usarmos apenas a lei de Moore (ou outras métricas de previsão existentes), em que apenas um ou vários fatores de direcionamento são usados para descrever o desempenho de um sistema de computação (veja aqui ). Além disso, os benefícios de diferentes implementações de hardware (por exemplo, elétrico, óptico) mudam de maneiras diferentes ao longo do tempo, tornando a previsão evolutiva ainda mais difícil.

Por exemplo, a fotônica integrada e possivelmente a plasmônica podem expandir certos canais de comunicação em uma placa ou mesmo em um chip. Como resultado, os problemas de dissipação de energia térmica serão significativamente mitigados, bem como o aumento da largura de banda de dados com a capacidade de superar a barreira de eficiência digital eletrônica usando abordagens conceituais, como multiplexação por divisão de comprimento de onda ( WDM ), momento angular óptico ou formatos de modulação mais elevados, como modulação de amplitude de polarização. modulação (por exemplo, QAM ), onde a polarização de fase e amplitude são usadas simultaneamente (veja aqui e aqui ).

No que diz respeito às compensações com outras tecnologias, um transistor eletrônico com um nó de processo de 14 nm ocupa uma área 3 ordens de magnitude menor do que um modulador de anel de um microdisco fotônico, no entanto, a fotônica fornece interconexão no nível do canal sem fios capacitivos de carga / descarga, embora seja sinérgica em relação ao acima características únicas que suportam taxas de transferência de dados de até Tbps (veja aqui ). Figura 1. A natureza do desenvolvimento dos sistemas de computação, desde 1946 até os dias atuais, pode ser representada na forma de quatro indicadores diferentes: (a) Lei de Moore - baseada no crescimento do número de componentes de um chip, medido em unidades do número numérico de transistores; (b)

Lei de Kumi - reflete a eficiência energética por unidade de computação, bit / (s * Joule); (c) Índice de Makimoto, que inclui "inteligência", potência, tamanho e custo do sistema - medido em unidades de MIPS / (W * mm3 * $); e (d) a pontuação CLEAR definida na equação (4), que leva em consideração a latência do sistema além da pontuação Makimoto e os custos econômicos associados à introdução da nova tecnologia: MIPS / (s * W * mm3 * $). Os dados CLEAR fotônicos são baseados na previsão da Intel sobre fotônica de silício. As linhas tracejadas representam o ajuste linear (logarítmico) com base na taxa de crescimento inicial, com a duplicação da produtividade anual.

De acordo com os autores, o indicador de 5 fatores CLEAR (cujo nome representa a abreviatura Capability-to-Latency-Energy-Amount-Resistance) é de longe o mais confiável para descrever a evolução do desempenho computacional ao longo do período histórico conhecido, começando desde o início do surgimento das tecnologias de computação na década de 1940. e até o momento. Este indicador cobre os fatores físicos e econômicos associados ao ritmo de desenvolvimento de várias opções de computação. Portanto, CLEAR pode ser usado como um indicador quantitativo independente de tecnologia, uma vez que inclui dependências físicas e econômicas fundamentais.

Com base em observações e análises, os autores tiram duas conclusões principais:

- , ;

- ( ) , (.. CLEAR) ( ) .

O avanço da física fundamental, o gerenciamento da tecnologia de semicondutores e os custos econômicos requerem mudanças e adaptações constantes para avançar progressivamente na tecnologia dos sistemas de computação. Desde a fundação da indústria de semicondutores, a Lei de Moore mudou os fatores subjacentes várias vezes: da contagem de transistores, a indústria está se desdobrando (First Move) para a pegada e dimensionamento do transistor devido às restrições de tamanho de matriz e aumento da complexidade geral do sistema (veja aqui ).

O segundo salto ocorreu quando a frequência do relógio encontrou seus limites devido às restrições de dissipação de densidade de potência descritas pela lei de escala de Dennard (veja aqui) À medida que o dimensionamento dos transistores se aproxima dos limites físicos fundamentais, o número de transistores continua a aumentar neste momento devido ao paralelismo implementado em arquiteturas heterogêneas massivamente paralelas e multicore. Isso aumenta o gargalo na interconexão, resultando na necessidade de desabilitar certas áreas do chip ( "silício escuro" ). Assim, a taxa de crescimento mudou de uma duplicação inicial a cada 12 meses para cerca de 24 meses agora.

Recentemente, uma nova força motriz emergiu de um campo completamente diferente que influencia a evolução dos sistemas de computação e é a fotônica integrada e a nanofotônica hibridizada, onde o roteamento do sinal de luz é realizado por componentes fotônicos integrados passivos, enquanto os componentes ativos eletro-ópticos são amplificados por novas soluções:

- materiais reconfiguráveis;

- fortes interações da luz com a matéria, como plasmonics ou fotônica ENZ (epsilion-near-zero), juntos fornecendo um link de dados e largura de banda que ultrapassa a eletrônica convencional em dois níveis: o chip e o núcleo (veja aqui ).

Para essas novas tecnologias, simplesmente contar o número de componentes em um chip ou dimensionar a área ocupada e o custo como uma métrica separada não é possível porque não reflete com mais precisão a mudança real de desempenho. Também de grande importância é a tendência ao surgimento de outras tecnologias, como as utilizadas nas comunicações ópticas, nas quais vários sinais com diferentes comprimentos de onda são empacotados no mesmo canal físico e, assim, melhoram a utilização do hardware. Este é um fator significativo na avaliação do desempenho do sistema. Consequentemente, é necessária uma métrica holística que leve em consideração as múltiplas forças motrizes, a fim de fornecer uma comparação precisa da contribuição de diferentes soluções tecnológicas para a evolução dos sistemas de computação.

Um único indicador da evolução dos sistemas de computação

Para obter uma métrica independente de tecnologia, os autores coletaram dados sobre o desempenho de desktops, laptops, dispositivos móveis, servidores, estações de trabalho e supercomputadores desde a década de 1940 e os compararam com métricas tradicionais (Figura 1).

Em particular, a lei de Moore considera o número de transistores como o único fator suficiente (equação 1), enquanto a lei de Kumi já se baseia em dois fatores: energia e o número de cálculos, somando assim a base para o indicador, medido em bits / (s * J) (equação 2). Milhões de instruções por segundo (MIPS) por unidade de tamanho-custo-potência são conhecidas como a métrica Makimoto, já definida como uma métrica de 4 fatores (Equação 3).

Lei de Moore = Número de transistores [qtd.] (1)

Lei de Kumi= Cálculos / Energia [bits / (s * J)] (2)

Pontuação Makimoto = Inteligência / (Tamanho * Custo * Potência) [MIPS / (mm3 * $ * W)] (3)

Os valores desses três indicadores mostram um padrão de crescimento semelhante : Uma tendência de alta rastreia bem seus dados originais, mas apenas por um período limitado de tempo e, eventualmente, se desvia deles. Isso sugere que os fatores subjacentes não conseguiram capturar totalmente a força motriz real que domina a evolução dos sistemas de computação.

A análise das linhas de tendência na Fig. 1 mostra que o número de transistores originalmente (1950 - 1960) reflete bem a lei de Moore do crescimento anual duplo (linha verde clara tracejada, Fig. 1). No entanto, o dimensionamento da eficiência energética (ou seja, a Lei de Kumi) tornou-se o fator dominante no período seguinte (anos 1960-1970), já que simplesmente adicionar mais transistores era limitado pelo tamanho e complexidade do chip. Por esta razão, a Lei de Moore começou a se desviar da tendência de 2X / ano, enquanto a Lei de Makimoto ainda manteve sua taxa de crescimento original. Desde o final da década de 1970, fatores como tamanho e escala de potência atingiram gradualmente seu limite devido a problemas com processos de fabricação muito mais complexos, vazamento de energia e dissipação de calor.Junto com o surgimento do paralelismo (ou seja, processadores multi-core) e da escala econômica no mercado, a métrica Makimoto também se desvia (desde 1978). As linhas pontilhadas mostradas na Fig. 1 representa as projeções iniciais de crescimento da produtividade para cada lei. Essas linhas de tendência mostram como cada fator adicional introduzido pelas leis correspondentes afeta sua própria métrica de previsão original, mostrada como um desvio da previsão original. Ao ver essa tendência como um limite superior teórico na velocidade do desenvolvimento da tecnologia, agora é possível entender se a tendência “reivindicada” é realmente “real” ou não. Ou seja, se a lei atual é o motivo da desaceleração do desenvolvimento tecnológico ou se novos fatores de produtividade começam a dominar.também rejeitado (desde 1978). As linhas pontilhadas mostradas na Fig. 1 representa as projeções iniciais de crescimento da produtividade para cada lei. Essas linhas de tendência mostram como cada fator adicional introduzido pelas leis correspondentes afeta sua própria métrica de previsão original, mostrada como um desvio da previsão original. Ao ver essa tendência como um limite superior teórico na velocidade do desenvolvimento da tecnologia, agora é possível entender se a tendência “reivindicada” é realmente “real” ou não. Ou seja, é a lei atual o motivo da desaceleração do desenvolvimento tecnológico, ou novos fatores de produtividade começam a dominar.também rejeitado (desde 1978). As linhas pontilhadas mostradas na Fig. 1 representa as projeções iniciais de crescimento da produtividade para cada lei. Essas linhas de tendência mostram como cada fator adicional introduzido pelas leis correspondentes afeta sua própria métrica de previsão original, mostrada como um desvio da previsão original. Ao ver essa tendência como um limite superior teórico na velocidade do desenvolvimento da tecnologia, agora é possível entender se a tendência “reivindicada” é realmente “real” ou não. Ou seja, se a lei atual é o motivo da desaceleração do desenvolvimento tecnológico ou se novos fatores de produtividade começam a dominar.como cada fator adicional introduzido pelas leis relevantes afeta sua própria métrica de previsão original, mostrado como um desvio da previsão original. Ao ver essa tendência como um limite superior teórico na velocidade do desenvolvimento da tecnologia, agora é possível entender se a tendência “reivindicada” é realmente “real” ou não. Ou seja, é a lei atual o motivo da desaceleração do desenvolvimento tecnológico, ou novos fatores de produtividade começam a dominar.como cada fator adicional introduzido pelas leis relevantes afeta sua própria métrica de previsão original, mostrado como um desvio da previsão original. Ao ver essa tendência como um limite superior teórico na velocidade do desenvolvimento da tecnologia, agora é possível entender se a tendência “reivindicada” é realmente “real” ou não. Ou seja, é a lei atual o motivo da desaceleração do desenvolvimento tecnológico, ou novos fatores de produtividade começam a dominar.se a lei atual está causando a desaceleração no desenvolvimento de tecnologia ou se novos fatores de produtividade estão começando a dominar.se a lei atual é a razão para a desaceleração no desenvolvimento de tecnologia ou se novos fatores de produtividade estão começando a dominar.

Assim, até o momento, não há um indicador claro conhecido que possa:

- explicar mudanças de desempenho recentes;

- fornecer orientação sobre como prever o desempenho futuro.

A métrica CLEAR introduzida pelos autores inclui fatores de desempenho de uma variedade de opções de tecnologia que incluem restrições físicas e econômicas. A principal afirmação dos autores é que os fatores que compõem o CLEAR não são escolhidos aleatoriamente, mas são fundamentais para as tendências tecnológicas e econômicas:

CLEAR = Habilidade / (Atraso * Energia * Quantidade * Resistência) [[MIPS / (s * W * mm3 * $)]] (4)

ou no original:

CLEAR = (Capacidade) / (Latência * Energia * Quantidade * Resistência) [[MIPS / (s * W * mm3 * $)]]

Os autores, tendo formulado uma fórmula para o indicador CLEAR, determinam uma taxa de crescimento constante ao longo da evolução dos sistemas de computação, cobrindo o crescimento do desempenho em 4 ordens de magnitude ao longo de sete décadas. Além disso, a taxa real de desenvolvimento observada dobrou consistentemente a cada 12 meses. Essa pontuação de 5 fatores é determinada com base no conceito de desempenho e custo. CLEAR pode ser aplicado no nível do dispositivo, esquema e sistema.

Por exemplo, no nível do sistema, CLEAR é estruturado da seguinte maneira:

Capacidade C é o desempenho do sistema medido pelo produto de milhões de instruções por segundo (MIPS) e comprimento de instrução;

Atraso mínimo Lrefere-se à frequência do relógio e é limitada pela janela de tempo entre dois ciclos de relógio adjacentes;

A energia E representa o nível de consumo de energia para tal sistema operar de forma a obter uma determinada potência, expressa em unidades de watts;

A quantidade A representa o volume espacial (ou seja, o tamanho físico) do sistema e é uma função da dimensão do processo;

Resistance R quantifica a resistência econômica à adoção de novas tecnologias pelo mercado. Basicamente, os autores tomam um modelo econômico baseado na curva de experiência do Boston Consulting Group (BCG), que explica a relação entre a produção total e o custo unitário (veja aqui ).

Os autores derivam uma relação linear entre a escala logarítmica da unidade de preço e tempo, e então confirmam essa relação comparando os dados históricos (veja aqui e aqui ) com CLEAR.

Os autores observam que a métrica MIPS como medida de desempenho está sendo substituída por métricas como operações de ponto flutuante (FLOPS) devido à sua suscetibilidade ao conjunto de instruções subjacente. CLEAR foi aplicado a várias arquiteturas de processador ao longo da história para as quais outras métricas de desempenho não estão disponíveis em suítes de benchmark conhecidas (como SPEC ou LINPAC). No entanto, para fazer do MIPS uma métrica de desempenho representativa, os autores ponderaram (ou seja, multiplicaram) cada instrução por seu comprimento, dando assim a métrica geral relativa em bits / s.

Tendências de desenvolvimento de sistemas de computador

Depois de comparar todos os quatro indicadores mostrados na Fig. 1, descobrimos que quando uma métrica inclui fatores mais relevantes, seu ponto inicial de desvio da tendência original ocorre mais tarde. Ao contrário do CLEAR, que mostra a correspondência exata dos dados em tudo. Assim, descobrimos empiricamente que o desempenho computacional está constantemente crescendo a uma taxa fixa em cerca de duas vezes por ano e é independente da tecnologia. Ao testar novas máquinas de computação, como aquelas baseadas em fotônica integrada, conforme previsto pela IBM (veja aqui ), descobrimos que tais tecnologias poderiam de fato continuar a tendência evolutiva de desenvolvimento com um crescimento anual duplo (estrelas vermelhas na Fig. 1).

Além disso, você descobrirá que o desvio relativo da linha de tendência 2X / ano pode ser usado para classificar uma métrica do sistema de computação. Por exemplo, os custos indiretos adicionais (ou seja, tamanho físico, simultaneidade, resfriamento, baixas economias de escala e custos de fabricação) em supercomputadores mostram seus piores valores CLEAR em comparação com todos os outros tipos de computadores, como laptops e dispositivos móveis, apesar de seus maior produtividade (círculos pontilhados, Fig. 1 c, d). O alto paralelismo de tecnologias multicore usadas em supercomputadores foi desafiado pelo retorno da computação à energia descrita na Lei de Amdahl (veja aqui) Embora os supercomputadores forneçam desempenho petaflop, toda a infraestrutura se assemelha a uma infraestrutura de computador de cinco a trinta anos atrás, o que questiona o futuro por sua escalabilidade.

Análise CLARA

Para obter uma compreensão mais detalhada do impacto relativo de cada um dos 5 fatores CLEAR, os autores decompor o indicador em fatores individuais, opostos um ao outro, para revelar as reais forças motrizes ao longo do tempo.

Combinações de fatores usados na Fig. 2, representam C versus LEAR, CLE versus AR e CLEA versus R (Fig. 2, C = capacidade, L = atraso, E = energia, A = quantidade, R = resistência). Além disso, a taxa de exclusão C 'é mostrada em comparação com todos os outros fatores, uma vez que o único fator de escala nos primeiros anos da indústria de semicondutores é o número de componentes em um chip. É importante notar que as posições relativas de cada ponto de dados são mais importantes do que os valores exatos em ambos os eixos X e Y e, portanto, ambos os eixos são normalizados em um, permitindo que cada caso seja comparado.

Uma vez que as áreas sombreadas em azul e vermelho representam o crescimento linear e as áreas de saturação, respectivamente, as mudanças sucessivas do ponto de pivô para a direita são facilmente detectadas conforme o número de fatores considerados para o eixo x (isto é, o tempo relativo) aumenta. Para entender isso, os fatores no eixo X podem ser vistos como a força motriz do indicador, enquanto os valores no eixo Y indicam as condições reais de rastreamento das forças motrizes em questão. Consequentemente, um domínio linear significa que os fatores no eixo X ainda dominam o desenvolvimento da tecnologia, enquanto a força motriz da tecnologia começa a se deslocar para outros fatores à medida que entra no domínio de saturação. Este resultado coincide com a observação feita de que a evolução de um sistema computacional sempre cresce a essa taxa constante, e uma discrepância com o indicador ocorre somente sequando outras forças motrizes aparecem.

Figura 2. Análise CLEAR da força motriz.

O indicador CLEAR é dividido em quatro grupos, cada um dos quais consiste em duas partes: um coeficiente que demonstra fatores no desenvolvimento de tecnologia (eixo X) e um fator de divulgação, que mostra a capacidade de rastrear um fator selecionado ou combinação de fatores (eixo Y). Os resultados mostram que um desvio posterior do desenvolvimento normalizado é observado quando mais fatores são levados em consideração para descrever o desempenho dos sistemas de computação. (a) Velocidade elusiva C 'versus Atraso-Energia-Quantidade-Custo (LEAR); (b) Capacidade C versus Atraso-Energia-Quantidade-Custo (LEAR); (c) Capacidade de Atraso-Energia (CLE) versus Quantidade-Custo (AR); (d)Capacidade de Delay-Energy-Quantity (CLEA) versus Custo R. Os eixos X e Y são normalizados para um para melhor comparação. As áreas de crescimento linear e saturação são cobertas com sombras azuis e vermelhas, respectivamente.

Aplicativo CLEAR

É importante que a capacidade de acompanhar perfeitamente a evolução de várias tecnologias permita que a CLEAR preveja substituições tecnológicas futuras e determine o padrão para a tecnologia futura, incluindo sua hibridização, por exemplo, entre eletrônica e fotônica (veja aqui , aqui , aqui e aqui ).

Mudança de tecnologia

As interconexões fotônicas no chip recentemente mostraram alta capacidade de transferência de dados (superior às interconexões elétricas convencionais) quando hibridizadas com dispositivos plasmônicos ativos (veja aqui ). Embora o roteamento óptico de dados seja percebido como uma possível solução para eliminar gargalos de comunicação entre núcleos de computação e seja comumente usado em data centers e supercomputadores, a fotônica integrada ainda não foi implementada no setor de consumo convencional. Isso parece surpreendente à primeira vista, pois estudos anteriores sugeriram um desempenho superior na hibridização fóton-plasmão. Portanto, a questão é: por que a fotônica integrada não é usada em produtos de mercado de massa?

Para responder a esta pergunta, vamos comparar CLEAR para ligações eletrônicas com ligações híbridas fóton-plasmon dependendo do tempo de evolução e distância de propagação do sinal (Fig. 3). Aqui, a manipulação da luz é realizada usando blocos de construção "ativos" plasmônicos (fonte, modulador, detector, interruptor) (veja aqui e aqui), enquanto a propagação da luz é processada por fotônica de baixa perda com base em plataformas de silício ou nitreto de silício. A eletrônica é comparada a esta variante de um híbrido plasmon-fóton, porque a separação da funcionalidade ativa e passiva em um híbrido plasmon-fotônico resulta em maior desempenho (ou seja, menor latência, maior rendimento, menor função de energia por bit). As curvas de superfície resultantes mostram que a eletrônica CLEAR e a fotônica de plasmon têm uma linha de equilíbrio (interseção das superfícies, Fig. 3), que é dimensionada tanto no tempo quanto na distância de propagação do sinal. Curiosamente, ainda hoje, a eletrônica ainda está à frente da fotônica com um tamanho de chip de 1 cm no comprimento de transferência de informações.Portanto, a eletrônica ainda é usada comercialmente em cristais, ao contrário da fotônica. Os investimentos e desenvolvimentos em eletrônica ao longo do último meio século, portanto, criaram sustentabilidade tecnológica (barreiras de entrada) para outras tecnologias. Essa escala resultou no custo do transistor de apenas um bilionésimo do custo de um dispositivo fotônico, ou menos.aqui ). Figura 3. Comparação dos índices CLEAR para interconexão elétrica (azul) e híbrida fóton-plasmônica (vermelho) em um chip, dependendo do comprimento da ligação e do tempo de desenvolvimento da tecnologia. Tamanho do chip = 1 cm, comprimento da ligação e ano de escrita (2019) são marcados em vermelho. Os seguintes modelos foram implantados; a) um modelo de largura de banda baseado no número de transistores e dispositivos ópticos em um chip, que pode ser considerado como o modelo original da lei de Moore; b) um modelo de eficiência energética baseado na lei de Kumi, que é limitada pelo limite de Landauer kB * T * ln (2) ≈ 2,75 sJ / bit, (kB é a constante de Boltzmann; T é a temperatura); em)

um modelo de sustentabilidade econômica baseado em modelos de desenvolvimento tecnológico até 2019, segundo o qual o custo de um canal eletrônico é inferior a um bilhão ou um milionésimo do custo de um canal híbrido; d) um modelo de simultaneidade (pós-2006) descrevendo a arquitetura multicore e as limitações do "silício escuro" na interconexão elétrica. O ponto amarelo está localizado na interseção das duas tecnologias durante 2019, quando a tecnologia Hybrid Plasmon-Photonics acaba de atingir o tamanho de um chip e começa a mostrar o melhor desempenho CLEAR em um chip.

À medida que a tecnologia e os processos de fabricação melhoram, a distância de equilíbrio de produtividade por um preço (ou seja, CLEAR) para a transmissão de pequenas quantidades de informações diminui devido à curva de custo mais plana da eletrônica em comparação com a fotônica, esta última seguindo uma lei de potência ao longo do tempo. Além disso, o custo começa a aumentar com o dimensionamento da densidade da interconexão elétrica, associado a custos adicionais devido a problemas físicos fundamentais em nós de transistores menores que 10 nm (veja aqui ). Em contraste, uma interconexão híbrida fóton-plasmonic é atualmente cara devido ao escalonamento incipiente que é o objetivo do American Institute for Integrated Photonics Manufacturing ( AIM Photonics) O dimensionamento agora é possível como resultado de avanços recentes em nanofotônica; o conceito de potencializar a interação da luz com a matéria torna possível criar comprimentos de onda compactos em dispositivos optoeletrônicos com as vantagens de alta eficiência energética e alta velocidade de operação devido à baixa capacitância elétrica (veja aqui ). Como resultado, espera-se que a distância de equilíbrio entre a eletrônica e as tecnologias híbridas de fóton-plasmon mude para distâncias mais curtas conforme avançamos na linha do tempo. Por exemplo, o chip fotônico de silício baseado em CMOS que a IBM demonstrou em 2015 está perto de atingir o equilíbrio (veja aqui) A fotônica integrada será capaz de substituir a eletrônica apenas se a velocidade de seu desempenho CLEAR puder acompanhar a tendência evolutiva geral dos sistemas de computação.

conclusões

Como vimos a partir do raciocínio acima, CLEAR pode ser considerado como um indicador técnico e econômico universal, não só por sua ampla aplicabilidade hierárquica (dispositivos, interconexão, níveis de sistema), mas também por sua capacidade de se adaptar a uma aplicação tecnológica específica. Por exemplo, para hibridização de rede em um cristal. O CLEAR não só pode ser usado como uma métrica de desempenho para prever a evolução de uma plataforma de tecnologia, mas também é possível comparar a capacidade geral da (s) plataforma (s) de tecnologia sob diferentes condições de uso, adicionando pesos a cada fator na equação (4) .

Nessa métrica CLEAR proposta originalmente, todos os cinco fatores afetam linearmente o valor CLEAR; no entanto, para uma aplicação particular que é criticamente dependente de um fator específico (ou combinação de fatores), cada fator em CLEAR pode ser ponderado de forma diferente. Para garantir a comparabilidade, mesmo entre essas métricas “sintonizadas”, pode ser necessário garantir que a soma de todos os coeficientes seja igual a 5, semelhante à normalização para a unidade, como a integral da função de onda na mecânica quântica. Por exemplo, um sistema de dispositivo portátil pode ter restrições severas de energia (E) e volume (A), resultando em uma métrica CLEAR C 0,8 L 0,8 E 1,2 A 1,2 Rpara essa tecnologia. Na verdade, seria interessante comparar tendências de diferentes métricas ajustadas com a capacidade de prever tecnologias futuras.

Além disso, podemos perceber que os canais ou redes de comunicação futuros serão reconfiguráveis dinamicamente, permitindo que o chip mude seu ponto operacional ideal dependendo da aplicação atual, carga, modo de energia, etc. Esses sistemas dinâmicos baseados em dados ( DDDAS) estão em demanda devido à sua capacidade combinada de processamento cognitivo. Espera-se que a adaptação de sistemas de computador a várias restrições tenha sinergia com sistemas emergentes de teoria da informação, como computação neuromórfica e de reservatório, onde a adaptação e o ajuste de "pesos" permitem o aprendizado de máquina, cálculo aritmético residual ou mesmo fotônica de silício incorporada de computação óptica. (veja aqui , aqui , aqui e aqui ).

Também é importante notar que, como aconteceu com todas as métricas de previsão de desempenho anteriores para plataformas de tecnologia, CLEAR pode eventualmente começar a se desviar de sua tendência original quando mais recursos físicos exclusivos forem usados na nova tecnologia. No momento, o CLEAR cobre adequadamente todos os fatores de desempenho dominantes nas tecnologias modernas, o que torna possível prever com precisão a evolução dos sistemas de computação no momento em que este livro foi escrito.

Assim, o CLEAR pode ser não apenas uma ferramenta para mapear e prever prospectos, mas também abrir caminho para plataformas de controle computacional inteligente e cognitivo baseadas em hardware, onde os trade-offs entre desempenho e custo são revisados e otimizados em tempo real.

Como resultado, o CLEAR pode ser visto como uma nova lei de Moore, que reflete integralmente as tendências de desenvolvimento de tecnologias em vários níveis de aplicação hierárquica.